L’ultima frontiera della tecnologia sta provocando molte polemiche negli USA, dove una ricerca della Stanford University, utilizzando un algoritmo per il riconoscimento facciale, avrebbe individuato un modo abbastanza accurato per scoprire da una sola immagine chi sarebbe gay o etero. Il cosiddetto “Al gaydar” ha scandagliato 35.000 immagini, captando correttamente nell’81% dei casi tra gli uomini e nel 74% tra le donne l’orientamento sessuale, percentuali nettamente superiori al 61% e 54% rispettivamente trovate attraverso giudizi espressi da persone in carne e ossa.

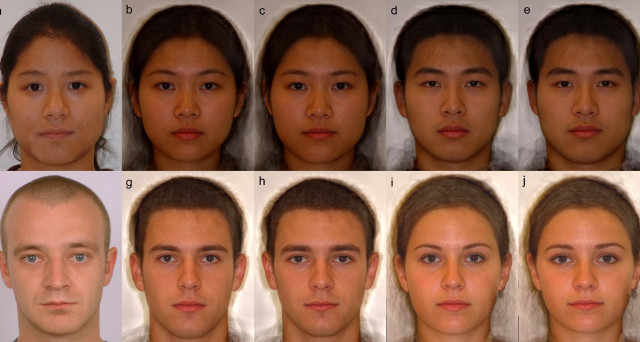

L’algoritmo parte dalla teoria degli ormoni pre-natali, secondo cui l’orientamento sessuale della persona sarebbe captabile da alcune caratteristiche facciali atipiche. Queste sarebbero la forma del naso, degli occhi, le sopracciglia, il mento, le guance e l’attaccatura dei capelli per l’uomo; il naso, i bordi delle labbra, i capelli e i lineamenti del collo per la donna.

La stessa ricerca rimarca come i risultati dell’algoritmo non implicherebbero che tutti gli individui omosessuali abbiano lineamenti femminili o che non possano esistere gay con tratti molto maschili. Ma la comunità LGBT americana ha immediatamente reagito alla pubblicazione dei dati di “Al gaydar”, invitando la stampa a non darvi spazio e sostenendo che questa tecnologia esporrebbe a rischi sia la comunità gay, sia gli stessi eterosessuali. (Leggi anche: Da Apple a Facebook, i 5 colossi che valgono una volta e mezza l’Italia)

Riconoscimento facciale per scoprire chi è gay, ma non solo

Una cosa appare certa: da oggi sembra che scoprire l’orientamento sessuale di una persona sia alla portata di clic. E non che manchino già applicazioni che puntano a carpire informazioni dal viso di un individuo, attraverso la sua lettura in una o più immagini.

Insomma, ancora una volta la tecnologia si presenta per quella che è: una straordinaria opportunità per migliorare la vita quotidiana delle persone, ma con un rovescio della medaglia abbastanza rischioso. Nel caso specifico, i programmi di riconoscimento facciale sarebbero altamente lesivi della privacy e persino della pacifica convivenza tra persone.

Partiamo da una constatazione: il sistema individuato dalla Stanford per riconoscere l’orientamento sessuale di una persona non sarebbe in sé perfetto. In primis, perché ha studiato solamente le immagini di persone appartenenti alla razza caucasica, ovvero di pelle bianca, mentre nel database studiato non vi erano immagini di persone di colore. Dunque, i risultati sarebbero affetti da “bias” etnico. E poi, la differenza effettuata è stata solo tra etero e gay, non essendovi stata presa in considerazione la possibilità che un individuo possa essere bisessuale o transessuale. (Leggi anche: I 10 manager gay più importanti del mondo)

I rischi di una tecnologia discutibile

Fatte le opportune precisazioni, il riconoscimento facciale pone molti problemi etici. Anzitutto, perché potrebbe essere gestito da persone e nel mondo sbagliato. Immaginiamo cosa accadrebbe se un’applicazione dal telefonino ci consentisse di capire se un uomo o una donna appena conosciuti siano realmente etero. O se un’azienda utilizzasse questo sistema per cercare di selezionare i propri dipendenti sulla base del loro orientamento sessuale.

Peggio, se fossero i governi a utilizzare le miliardi di immagini a disposizione grazie a social come Facebook per capire quale cittadino sarebbe gay, quale ancora un potenziale criminale, etc, di fatto schedando un’intera popolazione a fini politici o di altro tipo. I rischi sono ancora maggiori, se si pensa che come tutte le tecnologie, anche Al gaydar si mostra imperfetta. Nel migliore dei casi, i risultati sono stati errati al 9%, cosa che implica il pericolo di un individuo di venire discriminato anche sulla base di informazioni errate. (Leggi anche: Testamento online con Google, Twitter e Facebook: come lasciare l’eredità digitale)