I ricercatori del MIT hanno fato un esperimento tanto bizzarro quando affascinante, ecco a voi Norman, l’intelligenza artificiale che ha tutte le carte in regola per diventare un grande serial killer.

MIT creano algoritmo psicopatico

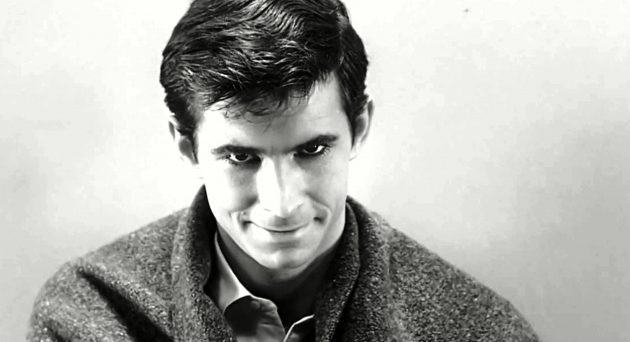

Sfruttando la parte più morbosa e malata di Reddit, il team di ricercatori ha tirato su uno psicopatico che potenzialmente potrebbe competere con il personaggio di Psycho (da qui il nome Norman, come il Bates del famoso film). Immagini di violenza e morte da somministrare in quantità industriale alla povera macchina, ci viene in mente in questo caso Arancia Meccanica, quando il cattivo protagonista viene obbligato a guardare questo tipo di immagini allo scopo di provocare nausea e farlo quindi diventare buono.

Potrebbe interessarti anche: Google Maps, le 10 funzioni che non tutti conoscono

In realtà le cose sono meno sensazionalistiche di come le abbiamo appena descritte. Al momento Norman non ha fatto del male a nessuno, e mai potrà farlo, poiché ad ogni modo si tratta soltanto di un algoritmo senza corpo. Che tale IA abbia però le idee un po’ confuse è chiaro. Dopo aver assimilato tutto il peggio del web è stato fatto a Norman il test di Rorschach. Si tratta del celebre test che tante volte abbiamo visto anche nei film dove lo psicologo di turno chiede di esaminare delle macchie astratte.

Ebbene, a quanto pare Norman in quelle macchie ci ha visto sempre del marcio, scene di violenza, proprio come quelle viste durante l’apprendimento su Reddit. A che pro questo esperimento? Il ricercatori del MIT hanno così dimostrato la fallacia potenziale a cui incorrono gli algoritmi, in sostanza assimilare dati non significa imparare, anzi in alcuni casi può diventare addirittura pericoloso.

Potrebbe interessarti anche: Anche l’Italia sotto attacco malware, ecco la mail ruba password